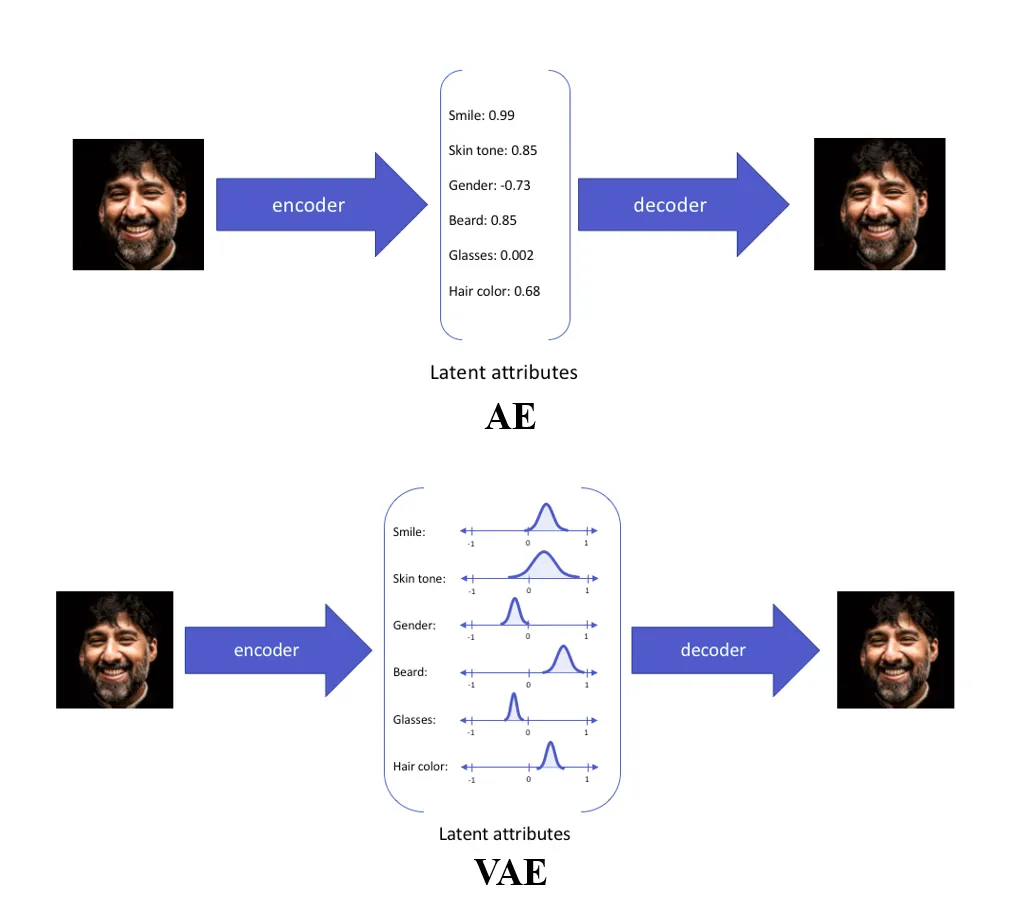

AE和VAE均基于编码器-解码器的核心架构,但二者的核心定位、数学原理、能力边界完全不同:AE是面向特征学习/数据压缩的确定性无监督模型,VAE是面向生成任务的概率式深度生成模型,VAE从根本上解决了AE无法有效生成新样本的核心痛点。

一、AE(AutoEncoder,自动编码器)

1. 核心定义与架构

AE是一种经典的无监督神经网络,核心目标是学习输入数据的低维紧致特征表示,同时完成输入数据的重构,整体为对称的“编码器-解码器”两段式结构:

- 编码器:将高维输入数据$x$(如图像、文本向量)通过非线性神经网络,映射为一个低维、固定的确定性隐向量$z$(也叫编码/潜码),强制模型学习数据的核心特征。

- 解码器:将低维隐向量$z$通过反向非线性映射,还原为与原始输入$x$维度完全一致的重构输出$x’$。

2. 训练目标与核心特性

- 损失函数:仅优化重构损失,常用均方误差(MSE)或交叉熵,公式为:$$\mathcal{L}_{AE} = \text{MSE}(x, x’)$$

- 核心优势:结构简单、易训练、易实现,可实现非线性降维(效果优于线性的PCA),适配特征提取、数据降噪等基础任务。

- 致命局限:隐空间离散、无序、存在大量“空洞”。只有训练集中样本对应的隐向量能被解码器有效重构,从隐空间随机采样的向量,几乎只能生成无意义的噪声,不具备生成新样本的能力。

3. 典型应用与常见变体

- 核心应用:高维数据降维、图像去噪、异常检测(重构误差过大的样本判定为异常)、数据压缩、预训练特征提取。

- 常见变体:欠完备AE(标准AE)、稀疏AE、去噪AE(DAE)、收缩AE。

二、VAE(Variational AutoEncoder,变分自动编码器)

1. 核心定义与设计初衷

VAE是AE架构与贝叶斯变分推断结合的深度生成模型,核心解决AE隐空间不可控、无法生成有效新样本的问题。它不再学习确定性的隐向量,而是学习输入数据在隐空间的概率分布,让隐空间连续、规整、可采样,从而具备成熟的生成能力。

2. 核心架构与关键创新

整体仍保留编码器-解码器框架,但核心模块有本质革新:

- 编码器(推断网络):不再输出固定的隐向量$z$,而是输出隐变量$z$的后验分布$q(z|x)$的参数。通常假设隐变量服从高斯分布,因此编码器输出两个向量:均值$\mu$和对数方差$\log\sigma^2$(避免方差出现负数,提升训练稳定性)。

- 重参数化技巧(Reparameterization Trick):VAE可训练的核心工程实现。

直接从$N(\mu,\sigma^2)$采样$z$会导致梯度断裂,无法反向传播优化模型。因此将采样过程拆解为:$$z = \mu + \sigma \odot \epsilon, \quad \epsilon \sim \mathcal{N}(0, I)$$其中随机性来自与模型参数无关的噪声$\epsilon$,梯度可正常回传到$\mu$和$\sigma$,实现模型的端到端训练。 - 解码器(生成网络):输入采样得到的隐向量$z$,通过神经网络映射为生成样本$x’$,学习条件分布$p(x|z)$。

3. 训练目标与损失函数

VAE的优化目标是最大化证据下界(ELBO),等价于最小化两部分损失之和:

$$\mathcal{L}_{VAE} = \mathcal{L}_{recon} + \mathcal{L}_{KL}$$

- 重构损失$\mathcal{L}_{recon}$:与AE一致,衡量生成样本与原始样本的相似度,保证生成内容的保真度,常用MSE或二值交叉熵。

- KL散度损失$\mathcal{L}_{KL}$:正则项,约束编码器输出的后验分布$q(z|x)$与先验分布$p(z)$(标准正态分布$\mathcal{N}(0,I)$)的距离,强制隐空间连续、光滑、无空洞,确保随机采样的有效性。

4. 核心优势与局限

- 核心优势:隐空间连续可解释,具备强大的生成能力,可实现样本插值、属性可控编辑;训练过程稳定,无需对抗训练(相比GAN),同时保留特征学习能力。

- 局限:生成样本的细节、清晰度弱于GAN,易出现重构模糊问题,受高斯分布假设的约束。

三、AE与VAE核心差异对比

| 对比维度 | AE(自动编码器) | VAE(变分自动编码器) |

|---|---|---|

| 核心定位 | 无监督特征学习/数据压缩模型 | 深度概率生成模型 |

| 编码器输出 | 确定性的固定隐向量$z$ | 隐变量分布的参数(均值$\mu$、方差$\sigma^2$) |

| 隐空间特性 | 离散、无序、存在大量空洞,不可控 | 连续、光滑、规整,服从标准正态分布 |

| 训练目标 | 仅最小化重构误差 | 重构损失 + KL散度正则项(最大化ELBO) |

| 核心技术 | 基础反向传播,无特殊技巧 | 变分推断、重参数化技巧 |

| 生成能力 | 无有效生成能力,随机采样生成无意义内容 | 成熟的生成能力,随机采样可生成合理新样本 |

| 核心应用 | 降维、特征提取、图像去噪、异常检测 | 图像生成与编辑、数据增强、分子生成、可控文本生成 |

生成阶段其实不需要编码器,而是直接从先验p(z)采样吗? 那如果我想输入一张图再从中采样生成可以吗

一、第一个问题:标准VAE的纯随机生成阶段,确实完全不需要编码器

核心结论先给透:

标准VAE的无约束随机生成新样本场景,推理阶段只需要保留解码器,编码器可以完全丢弃,直接从先验分布 $p(z)=\mathcal{N}(0,I)$ 中采样隐向量 $z$,输入解码器即可生成有效样本。

背后的核心逻辑

- 训练的核心目的,就是为了让生成阶段能脱离编码器

我们训练VAE时,强制编码器输出的后验分布 $q(z|x)$ 逼近先验 $p(z)$,本质就是完成「训练分布」和「生成分布」的对齐:- 训练时,解码器接收的 $z$ 来自 $q(z|x)$(编码器输出的分布);

- 生成时,我们让 $q(z|x)$ 和 $p(z)$ 几乎完全重叠,解码器就可以无缝处理从 $p(z)$ 中采样的 $z$,无需再依赖编码器。

- 这是VAE和AE最核心的能力区别

AE的编码器和解码器是强绑定的,没有编码器就无法得到隐向量 $z$,解码器完全无法独立工作,更不可能生成新样本;而VAE的解码器本身就是一个完整的生成器,编码器仅在训练阶段负责“教会解码器隐空间的规则”,训练完成后即可在纯随机生成场景中被舍弃。

二、第二个问题:输入一张图再从中采样生成,完全可以,而且是VAE最核心的可控生成用法

你说的这个场景,正是VAE相比纯随机生成模型(如原生GAN)的核心优势之一,本质是利用训练好的编码器,把输入图映射到专属的隐空间分布,再在这个分布内采样,实现和输入图强相关的、可控的多样化生成,有成熟的实现路径和大量落地场景。

1. 基础实现:输入单张图,生成同语义的多样化变体

这是最贴合你需求的基础方案,核心是「用编码器锁定输入图的语义分布,在分布内采样生成变体」,步骤完全对应VAE的训练逻辑,零额外改造:

- 输入原图映射到隐空间:将你输入的图像 $x$ 输入训练完成的编码器,得到这张图专属的后验分布参数:均值 $\mu_x$ 和方差 $\sigma_x^2$(也就是 $q(z|x)$ 的参数);

- 专属分布内采样:用重参数化技巧,从这个 $q(z|x)$ 中多次采样,得到多个不同的隐向量 $z$:$$z = \mu_x + \sigma_x \odot \epsilon, \quad \epsilon \sim \mathcal{N}(0, I)$$每次采样的随机噪声 $\epsilon$ 不同,得到的 $z$ 就不同,但都严格落在输入图对应的语义分布内;

- 解码生成:将采样得到的多个 $z$ 分别输入解码器,即可生成多张和原图核心语义一致、但有合理细节差异的新样本。

举个直观的例子:

输入一张手写数字“5”的图片,编码器得到对应的 $\mu_x$ 和 $\sigma_x$,采样后生成的,都是不同写法、不同粗细、不同倾斜角度的“5”,不会变成其他数字;输入一张人脸图,生成的都是同一个人的不同表情、不同光照、不同微小姿态的人脸。

2. 进阶拓展:基于输入图的可控生成玩法

这个逻辑可以延伸出VAE最常用的高阶功能,全部都需要编码器参与:

- 精准图像编辑:先通过编码器得到输入图的均值 $\mu_x$(最贴合原图的隐向量),再手动调整隐向量中对应特定语义的维度(比如人脸的年龄、微笑程度、发型),再输入解码器,即可生成编辑后的图像,实现“指哪改哪”的可控生成;

- 图像插值过渡:输入两张图A和B,分别通过编码器得到 $\mu_A$ 和 $\mu_B$,在两个均值之间做线性插值,得到一系列中间隐向量 $z$,输入解码器即可生成从A平滑过渡到B的连续图像,实现丝滑的形态/语义渐变;

- 图像修复/去噪:输入破损/带噪的图像,通过编码器得到隐分布,采样后解码器会输出符合语义的完整/干净图像,利用的就是VAE学到的真实数据先验。

3. 关键注意事项

- 采样的方差控制:如果 $\sigma_x$ 太小,采样的 $z$ 几乎和 $\mu_x$ 完全一致,生成的图和原图几乎没有差异,失去多样性;如果 $\sigma_x$ 太大,采样的 $z$ 会偏离输入图的语义分布,生成的内容会失去原图的核心特征,退化为随机生成。

- 和AE重构的本质区别:AE只能输出一个固定的隐向量,得到一张固定的重构图;而VAE的编码器输出的是一个分布,可以无限采样生成无限个同语义的变体,这是概率建模带来的核心优势。

- 编码器的复用前提:所有这些玩法,都必须使用和解码器配对训练完成的编码器,不能用随机初始化的编码器,也不能用其他任务训练的编码器。

参考链接:

AE(自动编码器)、VAE(变分自动编码器)、VQ-VAE(向量量化变分自编码器) 的区别和联系?-CSDN博客

(95 封私信 / 82 条消息) 一文理解变分自编码器(VAE) – 知乎